腾讯混元大模型介绍

腾讯混元大模型是由腾讯全链路自研的通用大语言模型,拥有超千亿参数规模,预训练语料超 2 万亿 tokens,具备强大的中文创作能力,复杂语境下的逻辑推理能力,以及可靠的任务执行能力。

值得一提的是,腾讯混元大模型是一个“从实践中来,到实践中去”的实用级大模型。当前,腾讯云、腾讯广告、腾讯游戏、腾讯金融科技、腾讯会议、腾讯文档、微信搜一搜、QQ 浏览器等超过 50 个腾讯业务和产品,已经接入腾讯混元大模型测试,并取得初步效果。

腾讯混元大模型API

- 腾讯混元大模型API控制台

- 腾讯混元大模型API说明文档(3.0)

- 腾讯混元接入小狐狸教程

腾讯混元大模型官网

- 腾讯混元助手官网:https://hunyuan.tencent.com/

- 腾讯混元助手小程序:微信中搜索“腾讯混元助手”或者扫描下方小程序码体验

- 腾讯混元公众号:微信中搜索”腾讯混元”公众号

腾讯将于9月7日正式发布混元大模型,请大家关注2023年腾讯全球数字生态大会。

腾讯全球数字生态大会官网,报名入口网址,腾讯将公布其在人工智能最新进展!

混元AI大模型的特点

全链路自研是腾讯混元大模型的首要特点。腾讯集团副总裁蒋杰介绍,腾讯混元大模型从第一个 token 开始从零训练,掌握了从模型算法到机器学习框架,再到AI基础设施的全链路自研技术。

腾讯在算法层面进行了一系列自研创新,提高了模型可靠性和成熟度。

针对大模型容易“胡言乱语”的问题,腾讯优化了预训练算法及策略,让混元大模型的幻觉相比主流开源大模型降低了 30% 至 50%;通过强化学习的方法,让模型学会识别陷阱问题;通过位置编码优化,提高了超长文的处理效果和性能;提出思维链的新策略,让大模型能够像人一样结合实际的应用场景进行推理和决策。

此外,腾讯还自研了机器学习框架 Angel,使训练速度相比业界主流框架提升 1 倍,推理速度比业界主流框架提升 1.3 倍。

得益于全链路自研技术,腾讯混元大模型能够理解上下文的含义,并且有长文记忆能力,可以流畅地进行专业领域的多轮对话。除此之外,它还能进行文学创作、文本摘要、角色扮演等内容创作,做到充分理解用户意图,并高效、准确地给出有时效性的答复。

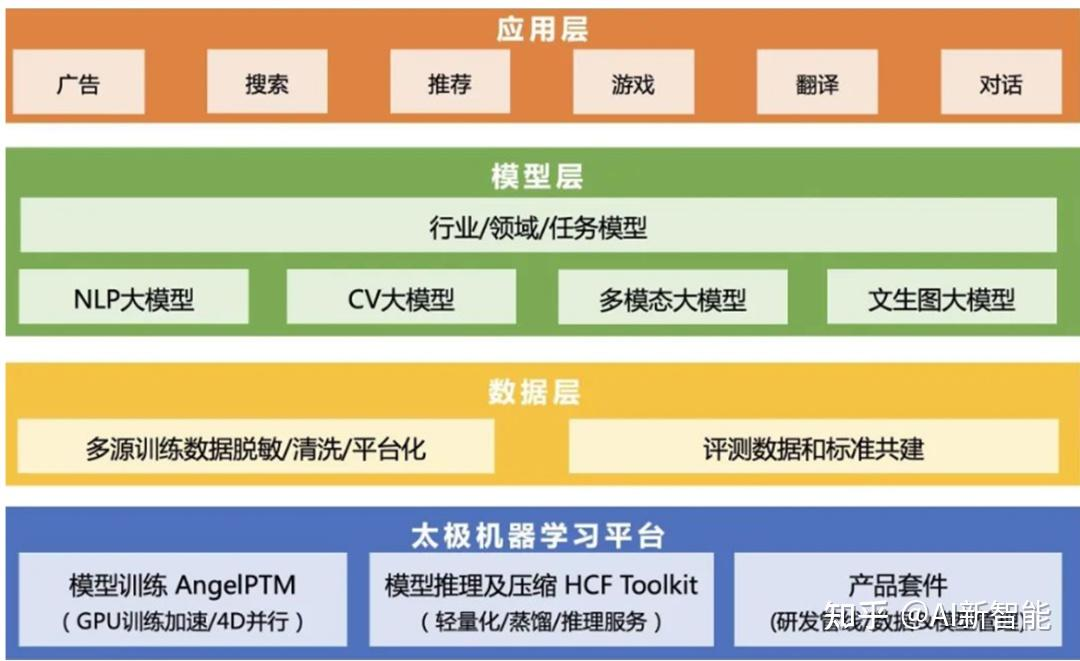

腾讯混元大模型架构

据报道,今年5月,腾讯针对ChatGPT对话式产品成立了“混元助手(HunyuanAide)”项目组,由腾讯首席科学家、腾讯AI Lab及Robotics X实验室主任张正友博士负责。

腾讯AI开放平台是一个功能强大、易于使用、价格实惠的人工智能服务平台,适用于各种场景下的AI应用开发和创新。

以太极平台的基础,配合强大的底层算力与低成本的高速网络基础设施,腾讯打造了首个可在工业界海量业务场景直接落地,并投入应用的万亿NLP大模型——HunYuan-NLP 1T。混元最快仅用256卡在一天内即可完成万亿参数大模型的训练,整体训练成本仅为直接冷启动训练万亿模型的1/8。

纵观混元在腾讯应用层、模型层的布局,我们可以发现,这样的布局策略,很有可能是想以统一的平台,实现技术复用和业务降本,支持更多的场景和应用。而这样的技术复用和多场景支持,则与腾讯在互联网领域独特的生态位有着密切关系。

混元大模型应用

在2023年腾讯全球数字生态大会上,蒋杰展示了腾讯会议、腾讯文档、腾讯广告等多个业务,在接入腾讯混元大模型后的实际应用情况。

比如腾讯会议基于混元大模型打造了腾讯混元助手,只需要简单的自然语言指令,就能完成会议信息提取、内容分析等复杂任务,会后还能生成智能总结纪要。据实测,在指令理解、会中问答、会议摘要、会议待办项等多个方面,混元大模型均获得较高的用户采纳率。

在文档处理方面,腾讯混元大模型支持数十种文本创作场景,在腾讯文档推出的智能助手功能中已有应用。同时,混元还能够一键生成标准格式文本,精通数百种Excel公式,支持自然语言生成函数,并基于表格内容生成图表,目前这些功能正在内测阶段,将在成熟后面向用户开放。

在广告业务场景,腾讯混元大模型支持智能化的广告素材创作,能够适应行业与地域特色,满足千人千面的需求,实现文字、图片、视频的自然融合。此外,基于混元大模型的能力,广告智能导购能够帮助商家在企业微信等场景,提升服务质量和服务效率。

混元大模型历史消息

3月30日,腾讯集团高级执行副总裁、云与智慧产业事业群CEO汤道生向媒体表示,腾讯正在研发类ChatGPT机器人。

腾讯在大模型领域的布局早已有之,其“混元”系列AI大模型覆盖了NLP、CV、多模态等基础大模型以及众多行业/领域大模型。这成为了腾讯构建类ChatGPT产品的坚实技术储备。

2022年5月,腾讯混元AI大模型在CLUE总排行榜、阅读理解、大规模知识图谱三个榜单同时登顶,一举打破三项纪录。

腾讯混元助手名称变更历史

数据统计

数据评估

关于腾讯混元大模型特别声明

本站智能信息网提供的腾讯混元大模型都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由智能信息网实际控制,在2025年4月26日 下午11:33收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,智能信息网不承担任何责任。

相关导航

Gemma是什么Gemma是由谷歌DeepMind和谷歌的其他团队开发的一系列轻量级、先进的开放AI模型,基于与Gemini模型相同的技术,旨在帮助开发者和研究人员构建负责任的AI应用。Gemma模型系列包括两种权重规模的模型:Gemma 2B 和 Gemma 7B,提供预训练和指令微调版本,支持多种框架,如JAX、PyTorch和TensorFlow,以在不同设备上高效运行。6月28日,第二代模型Gemma 2已发布。Gemma的官方入口Gemma的官网主页:https://ai.google.dev/gemma?hl=zh-cnGemma的Hugging Face模型:https://huggingface.co/models?search=google/gemmaGemma的Kaggle模型地址:https://www.kaggle.com/models/google/gemma/code/Gemma的技术报告:https://storage.googleapis.com/deepmind-media/gemma/gemma-report.pdf官方PyTorch实现GitHub代码库:https://github.com/google/gemma_pytorchGemma的Google Colab运行地址:https://colab.research.google.com/github/google/generative-ai-docs/blob/main/site/en/gemma/docs/lora_tuning.ipynbGemma的主要特性轻量级架构:Gemma模型设计为轻量级,便于在多种计算环境中运行,包括个人电脑和工作站。开放模型:Gemma模型的权重是开放的,允许用户在遵守许可协议的情况下进行商业使用和分发。预训练与指令微调:提供预训练模型和经过指令微调的版本,后者通过人类反馈强化学习(RLHF)来确保模型行为的负责任性。多框架支持:Gemma支持JAX、PyTorch和TensorFlow等主要AI框架,通过Keras 3.0提供工具链,简化了推理和监督微调(SFT)过程。安全性与可靠性:在设计时,Gemma遵循Google的AI原则,使用自动化技术过滤训练数据中的敏感信息,并进行了一系列安全评估,包括红队测试和对抗性测试。性能优化:Gemma模型针对NVIDIA GPU和Google Cloud TPUs等硬件平台进行了优化,确保在不同设备上都能实现高性能。社区支持:Google提供了Kaggle、Colab等平台的免费资源,以及Google Cloud的积分,鼓励开发者和研究人员利用Gemma进行创新和研究。跨平台兼容性:Gemma模型可以在多种设备上运行,包括笔记本电脑、台式机、物联网设备和云端,支持广泛的AI功能。负责任的AI工具包:Google还发布了Responsible Generative AI Toolkit,帮助开发者构建安全和负责任的AI应用,包括安全分类器、调试工具和应用指南。Gemma的技术要点模型架构:Gemma基于Transformer解码器构建,这是当前自然语言处理(NLP)领域最先进的模型架构之一。采用了多头注意力机制,允许模型在处理文本时同时关注多个部分。此外,Gemma还使用了旋转位置嵌入(RoPE)来代替绝对位置嵌入,以减少模型大小并提高效率。GeGLU激活函数取代了标准的ReLU非线性激活,以及在每个Transformer子层的输入和输出都进行了归一化处理。训练基础设施:Gemma模型在Google的TPUv5e上进行训练,这是一种专为机器学习设计的高性能计算平台。通过在多个Pod(芯片集群)上进行模型分片和数据复制,Gemma能够高效地利用分布式计算资源。预训练数据:Gemma模型在大量英语数据上进行预训练(2B模型大约2万亿个token的数据上预训练,而7B模型则基于6万亿个token),这些数据主要来自网络文档、数学和代码。预训练数据经过过滤,以减少不想要或不安全的内容,同时确保数据的多样性和质量。微调策略:Gemma模型通过监督式微调(SFT)和基于人类反馈的强化学习(RLHF)进行微调。这包括使用合成的文本对和人类生成的提示响应对,以及基于人类偏好数据训练的奖励模型。安全性和责任:Gemma在设计时考虑了模型的安全性和责任,包括在预训练阶段对数据进行过滤,以减少敏感信息和有害内容的风险。此外,Gemma还通过了一系列的安全性评估,包括自动化基准测试和人类评估,以确保模型在实际应用中的安全性。性能评估:Gemma在多个领域进行了广泛的性能评估,包括问答、常识推理、数学和科学问题解答以及编码任务。Gemma模型与同样规模或更大规模的开放模型进行了性能对比,在MMLU、MBPP等18个基准测试中,有11个测试结果超越了Llama-13B或Mistral-7B等模型。开放性和可访问性:Gemma模型以开源的形式发布,提供了预训练和微调后的检查点,以及推理和部署的开源代码库。这使得研究人员和开发者能够访问和利用这些先进的语言模型,推动AI领域的创新。常见问题Gemma一词的含义是什么?Gemma在拉丁语中的意思是“宝石”。Gemma是开源的吗?Gemma是开源开放的大模型,用户可在Hugging Face查看和下载其模型。Gemma模型的参数量是多少?Gemma目前提供20亿和70亿参数量的模型,后续还会推出新的变体。

文心大模型

百度推出的产业级知识增强大模型

比格AI PPT

比格AI PPT官网输入主题,1分钟生成PPT,支持一键换模

Watsonx.ai

Watsonx.ai是IBM于5月9日发布的新一代企业级生成式人工智能和机器学习平台,Watsonx.ai将由基础模型驱动的新的生成性人工智能和传统的机器学习结合起来,成为一个跨越人工智能生命周期的强大平台。使用Watsonx.ai,开发人员可以轻松地训练、验证、调整和部署模型,只需用一小部分数据在短期时间内快速建立人工智能应用。预计Watsonx.ai将在7月全面上市。

CodeGeeX – 免费AI编程助手

CodeGeeX官网免费AI编程助手 CodeGeeX 是一

通义万相

通义万相是阿里云通义旗下的AI创意作画平台,可提供AI艺术创作,可支持文生图、图生图、涂鸦作画、虚拟模特、个人写真等多场景的图片创作能力

悟道

2021年6月,北京智源研究院(BAAI)推出了悟道1.0的后续版本悟道2.0,作为中国第一个超大规模智能模型系统。悟道是一个语言模型,旨在在人类层面的思维上超越 OpenAI 的 GPT-3 和谷歌的 LaMDA。经过4.9TB的图像和文本训练,并在9个基准上超过了最先进(SOTA)水平,悟道比任何同行都更接近于实现通用人工智能(AGI)和人类水平的思维。悟道接受了4.9 TB高质量英文和中文图像和文本的训练:1.2TB中文文本数据2.5TB中文图形数据1.2TB英文文本数据悟道是基于开源的 MoE 系统 FastMoE 进行训练的。MoE是一种机器学习技术,其工作原理如下:将预测建模任务划分为子任务,针对每个子任务训练专家(学习者)模型,开发门控模型,该门控模型基于要预测的输入来学习咨询哪个专家,并组合预测。FastMoE使悟道能够并行咨询不同的专家模型,并切换到预测结果最好的模型。例如,如果输入是英文文本,悟道将使用预测模型,该模型可以在英文文本中生成回应。

腾讯云AI代码助手

腾讯云AI代码助手官网腾讯云AI代码助手是由腾讯云自主研发的