Gen-2介绍

Runway最新推出的AI视频生成模型,不用文本,一张图,Gen-2就能生成视频。

好玩到停不下来!

这意味着,一部大片,只需要图片就够了,岂不是人人都能成为好莱坞导演。

这不,已经有网友用Gen-2,结合PS修图,MusicGen、AudioLDM等工具配音,做出了「机器人总动员」翻版影片。

有人把Midjourney和Gen-2混搭,视频画面高级质感简直让人惊掉下巴。

有人用时4小时,制作了一部「火焰之旅」预告片,没有任何提示,只是图像!

有了Gen-2,重拍一部「狮子王」,绝对是不可想象的!

手把手教程

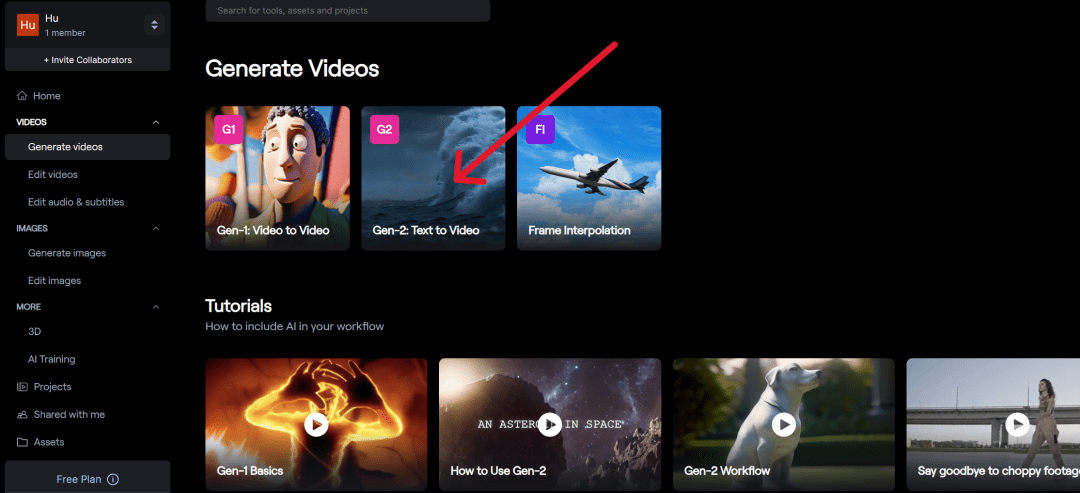

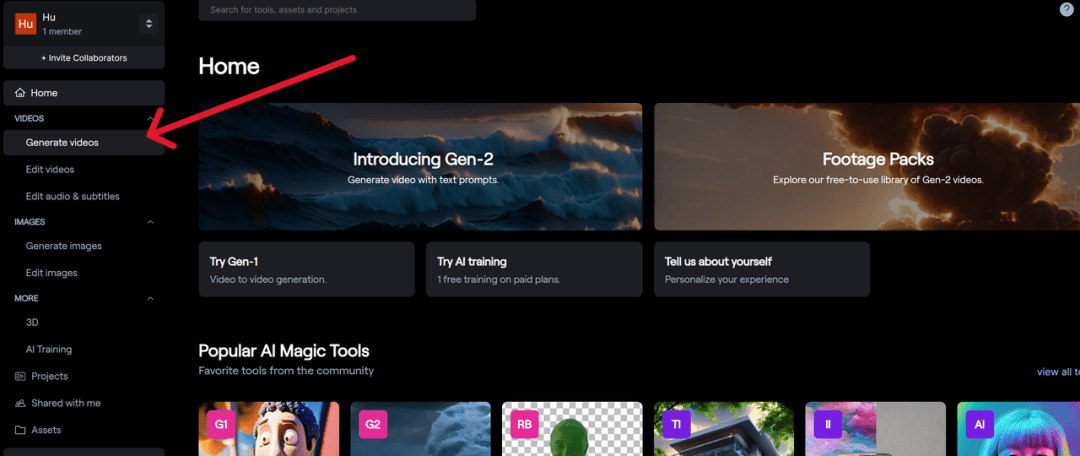

首先通过网页https://research.runwayml.com/gen2注册登录runway的账号,进入runway的编辑界面.

点击左侧的Generate Video。

然后点击屏幕中间的Gen-2:Text to Video进入Gen-2。

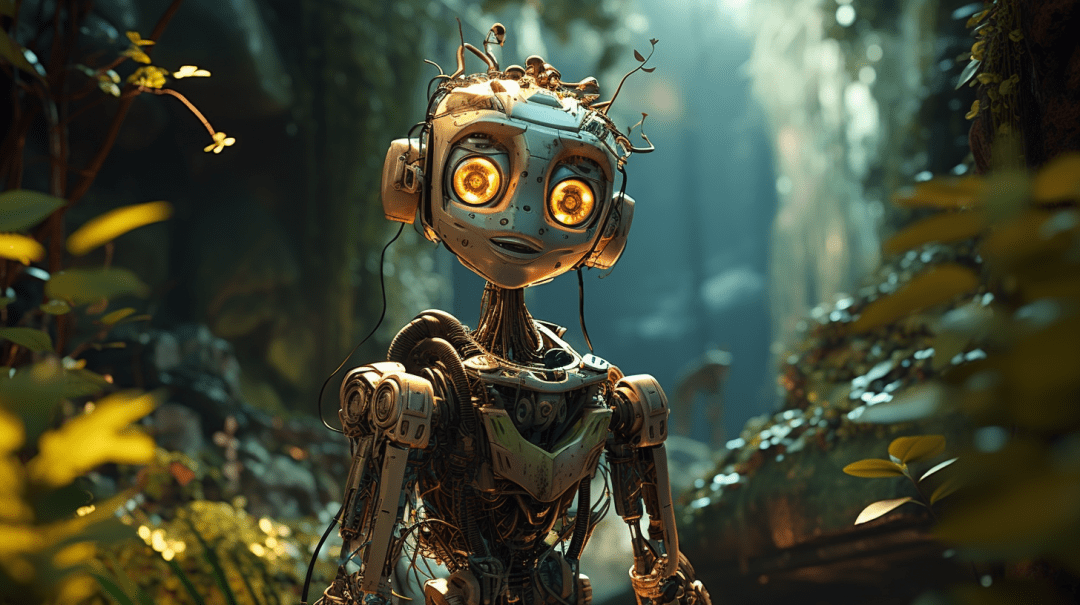

在左边的区域上传一张照片,小编这里用的是一张由Midjourney生成的机器人的照片。

提示词:Futuristic machine who is a kind robot who wants to save his planet from his human friends, cinematic, digital illustration, stylized, deep depth of field, high definition, –ar 16:9 –v 5.2

然后什么Prompt都不用输入,上传完照片之后就直接点击Generate。大概1分钟之后,一段4秒钟的视频就生成了。

图中的机器人瞬间就动了起来!

数据统计

数据评估

关于Gen-2特别声明

本站智能信息网提供的Gen-2都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由智能信息网实际控制,在2025年4月26日 下午10:51收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,智能信息网不承担任何责任。

相关导航

秒创是什么秒创(原一帧秒创)是基于秒创AIGC引擎的AI内容创作平台,为200万+创作者提供包括文字续写、文字转语音、文生图、图文转视频、AI成片、数字人播报等创作服务,产品包括秒创数字人、秒创AI帮写、秒创图文转视频、秒创AI视频、秒创AI语音、秒创AI作画等。秒创可以做什么?1. 秒创数字人智能数字人播报平台,输入文案,一键生成“真人”营销视频。AI数字人是以数字孪生等AI技术为基础,1:1还原真人形象、动作、神态、声音,无限逼近真人的数字分身。甚至还可以1:1还原真人形象+1:1还原真人音色,定制专属于您的数字人形象和声音,帮助您快速完成企业和个人IP打造,助力营销增长。2. 秒创图文转视频作为国内领先的智能内容创作平台,输入文案,智能匹配,AI将根据语意自动匹配画面,快速实现从文案到视频的制作,不仅支持文案、文章链接输入,同时也支持PPT文件导入,一键进行视频制作。画面匹配、智能配音、智能字幕等功能,AI都能完美实现。高效产出内容的同时,支持非常灵活的细节调整,文稿、音乐、配音、粗剪、LOGO、字幕、语速等功能,一应俱全。海量在线素材,可任意替换选择,一键图文成片。3. 秒创AI帮写智能文案写作平台,输入灵感,文思泉涌,出“手”成章。秒创提供短视频、营销、直播、风格文案4大类型AI帮写模板,全方位满足用户需求,甚至能直接输出直播脚本,大大提升运营和主播同学的效率。短视频内容、营销文案,秒创AI帮写统统都能帮你搞定。4. 秒创AI作画智能绘画生成平台,输入idea,灵感涌现,释放想象。只需输入作画文本关键词,描述出想要AI作画的场景画面,选择修饰词、艺术风格、艺术家风格,只需一键AI就可以自动生成精美绝伦的绘画作品。5. 秒创文字转语音秒创拥有独有的AI智能配音技术,一键输入文本自动完成配音,囊括全网热门发音人,56种AI配音可供选择,中文英文任意切换,输出的内容像真人一样,为创作者提供丰富的选择空间。AIGC创作平台秒创,依托强大的AI技术,识别文字语义,自动分镜头匹配素材,实现“自动化视频剪辑”,一键成片,一天轻松制作100条”高质量原创视频“。6.PPT转视频PPT转视频是秒创推出的新功能支持用户上传本地的PPT和PPTX文件,能将静态的幻灯片内容瞬间转化为动态的视频。备注解析成文案:用户可以在PPT的备注栏中输入文本,这些文本将被自动识别并转化为视频中的文案内容。矩阵化视频生成:通过智能技术,秒创平台能够将PPT内容矩阵化,生成视频,同时保留PPT中的所有文字和图片,使视频内容更加专业和精准。7.AI视频AI视频功能进行全面升级,新增了文生图与图生视频两大特性,支持多样的视频时长及比例选择。文字描述或图片素材转化为视频:提供文字描述或图片素材,转化为视觉作品。多种视频比例选项:平台提供了16:9、9:16、4:3等多种视频比例选项,适应不同场景下的应用需求。快速生成与一致性保证:确保输出内容的专业性和连贯性。秒创的产品价格目前秒创免费使用是完全没问题的,当然会员可享受更多权益。如果您对秒创有更高的使用需求,可以开通付费版,AI工具集专属渠道优惠18.8元(注册后7天内有效),截止时间2023.12.31。秒创的应用场景自媒体内容创作:自媒体作者可以用秒创平台将文字文章快速转化为吸引人的视频内容,提高粉丝互动和内容传播效果。企业营销推广:企业可以用秒创平台快速生成产品介绍、品牌宣传等营销视频,提升品牌形象和市场影响力。教育培训:教育机构和个人教师可以用秒创平台将教学资料转换为生动的视频课程,提升学习体验和教学效果。新闻媒体:新闻机构可以利用创平台快速将文字新闻转化为视频报道,适应现代受众的信息获取习惯。个人创作:普通用户可以用秒创平台简单易用的视频创作工具,实现个人创意的快速可视化。社交媒体运营:社交媒体运营者可以用秒创平台快速生成适合各平台的视频内容,提高账号活跃度和影响力。

Llama 3

Llama 3是什么Llama 3是Meta公司最新开源推出的新一代大型语言模型(LLM),包含8B和70B两种参数规模的模型,标志着开源人工智能领域的又一重大进步。作为Llama系列的第三代产品,Llama 3不仅继承了前代模型的强大功能,还通过一系列创新和改进,提供了更高效、更可靠的AI解决方案,旨在通过先进的自然语言处理技术,支持广泛的应用场景,包括但不限于编程、问题解决、翻译和对话生成。Llama 3的系列型号Llama 3目前提供了两种型号,分别为8B(80亿参数)和70B(700亿参数)的版本,这两种型号旨在满足不同层次的应用需求,为用户提供了灵活性和选择的自由度。Llama-3-8B:8B参数模型,这是一个相对较小但高效的模型,拥有80亿个参数。专为需要快速推理和较少计算资源的应用场景设计,同时保持了较高的性能标准。Llama-3-70B:70B参数模型,这是一个更大规模的模型,拥有700亿个参数。它能够处理更复杂的任务,提供更深入的语言理解和生成能力,适合对性能要求更高的应用。后续,Llama 3 还会推出 400B 参数规模的模型,目前还在训练中。Meta 还表示等完成 Llama 3 的训练,还将发布一份详细的研究论文。Llama 3的官网入口官方项目主页:https://llama.meta.com/llama3/GitHub模型权重和代码:https://github.com/meta-llama/llama3/Hugging Face模型:https://huggingface.co/collections/meta-llama/meta-llama-3-66214712577ca38149ebb2b6Llama 3的改进地方参数规模:Llama 3提供了8B和70B两种参数规模的模型,相比Llama 2,参数数量的增加使得模型能够捕捉和学习更复杂的语言模式。训练数据集:Llama 3的训练数据集比Llama 2大了7倍,包含了超过15万亿个token,其中包括4倍的代码数据,这使得Llama 3在理解和生成代码方面更加出色。模型架构:Llama 3采用了更高效的分词器和分组查询注意力(Grouped Query Attention, GQA)技术,提高了模型的推理效率和处理长文本的能力。性能提升:通过改进的预训练和后训练过程,Llama 3在减少错误拒绝率、提升响应对齐和增加模型响应多样性方面取得了进步。安全性:引入了Llama Guard 2等新的信任和安全工具,以及Code Shield和CyberSec Eval 2,增强了模型的安全性和可靠性。多语言支持:Llama 3在预训练数据中加入了超过30种语言的高质量非英语数据,为未来的多语言能力打下了基础。推理和代码生成:Llama 3在推理、代码生成和指令跟随等方面展现了大幅提升的能力,使其在复杂任务处理上更加精准和高效。Llama 3的性能评估根据Meta的官方博客,经指令微调后的 Llama 3 8B 模型在MMLU、GPQA、HumanEval、GSM-8K、MATH等数据集基准测试中都优于同等级参数规模的模型(Gemma 7B、Mistral 7B),而微调后的 Llama 3 70B 在 MLLU、HumanEval、GSM-8K 等基准测试中也都优于同等规模的 Gemini Pro 1.5 和 Claude 3 Sonnet 模型。此外,Meta还开发了一套新的高质量人类评估集,包含 1800 个提示,涵盖 12 个关键用例:寻求建议、头脑风暴、分类、封闭式问答、编码、创意写作、提取、塑造角色/角色、开放式问答、推理、重写和总结。通过与Claude Sonnet、Mistral Medium和GPT-3.5等竞争模型的比较,人类评估者基于该评估集进行了偏好排名,结果显示Llama 3在真实世界场景中的性能非常出色,最低都有52.9%的胜出率。Llama 3的技术架构解码器架构:Llama 3采用了解码器(decoder-only)架构,这是一种标准的Transformer模型架构,主要用于处理自然语言生成任务。分词器和词汇量:Llama 3使用了具有128K个token的分词器,这使得模型能够更高效地编码语言,从而显著提升性能。分组查询注意力(Grouped Query Attention, GQA):为了提高推理效率,Llama 3在8B和70B模型中都采用了GQA技术。这种技术通过将注意力机制中的查询分组,减少了计算量,同时保持了模型的性能。长序列处理:Llama 3支持长达8,192个token的序列,使用掩码(masking)技术确保自注意力(self-attention)不会跨越文档边界,这对于处理长文本尤其重要。预训练数据集:Llama 3在超过15TB的token上进行了预训练,这个数据集不仅规模巨大,而且质量高,为模型提供了丰富的语言信息。多语言数据:为了支持多语言能力,Llama 3的预训练数据集包含了超过5%的非英语高质量数据,涵盖了超过30种语言。数据过滤和质量控制:Llama 3的开发团队开发了一系列数据过滤管道,包括启发式过滤器、NSFW(不适合工作场所)过滤器、语义去重方法和文本分类器,以确保训练数据的高质量。扩展性和并行化:Llama 3的训练过程中采用了数据并行化、模型并行化和流水线并行化,这些技术的应用使得模型能够高效地在大量GPU上进行训练。指令微调(Instruction Fine-Tuning):Llama 3在预训练模型的基础上,通过指令微调进一步提升了模型在特定任务上的表现,如对话和编程任务。如何使用Llama 3开发人员Meta已在GitHub、Hugging Face、Replicate上开源其Llama 3模型,开发人员可使用torchtune等工具对Llama 3进行定制和微调,以适应特定的用例和需求,感兴趣的开发者可以查看官方的入门指南并前往下载部署。官方模型下载:https://llama.meta.com/llama-downloadsGitHub地址:https://github.com/meta-llama/llama3/Hugging Face地址:https://huggingface.co/meta-llamaReplicate地址:https://replicate.com/meta普通用户不懂技术的普通用户想要体验Llama 3可以通过以下方式使用:访问Meta最新推出的Meta AI聊天助手进行体验(注:Meta.AI会锁区,只有部分国家可使用)访问Replicate提供的Chat with Llama进行体验https://llama3.replicate.dev/使用Hugging Chat(https://huggingface.co/chat/),可手动将模型切换至Llama 3

Jan(Jan.ai)

Jan(Jan.ai)是一个免费开源的本地运行大模型并进行AI聊天对话的工具,可帮助用户在本地电脑(Windows、Mac、Linux)上安装、部署、运行并使用开源版本的ChatGPT替代大模型,如LLaMa、Mistral、Phi-2等20多个模型,也支持输入自己的OpenAI API Key以运行GPT。相较于AI工具集此前介绍的Ollama,该工具提供了对话UI和API服务器,适合开发者、研究人员或AI爱好者本地体验开源的大模型。Jan的主要功能本地运行开源大模型:支持LlaMa、Mistral、Phi-2、DeepSeek、Yi等20多个模型,可手动导入也可以在模型库下载模型简洁好用的聊天界面:软件界面清爽简洁、直观易用,直接在本地与开源大模型快速进行对话聊天支持多个平台:Jan支持在Windows、Mac(Intel、M1/M2/M3)和Linux等操作系统运行,后续还将推出移动端APP。内置API服务器:与OpenAI API兼容,可通过API获取模型信息、下载、启动、停止模型及聊天等如何使用Jan访问Jan的官网(jan.ai),选择对应的电脑操作系统版本,点击Download进行下载然后安装并打开软件,在软件界面的左下角点击Download your first model进入模型库Hub界面,选择你感兴趣的模型进行下载,下载完成后点击Use使用该模型在对话界面输入你的描述即可与你选择的模型进行对话啦Jan还在持续开发中,后续会支持移动端APP、创建AI助理、推理引擎、插件扩展等功能。

Viva

Viva是什么Viva是由智象未来(HiDream.ai)推出的一个免费的AI创意视觉生成平台,提供文本到图像、文本到视频、图像到视频等多种生成功能。用户只需输入描述性的文字或上传图片,Viva AI就能生成具有逼真效果的短视频。该平台具备AI视频生成、AI图像增强、视频增强、创意滤镜、和自动背景移除等特性,支持多种视频参数设置,如长宽比、运动强度等,并且提供4K分辨率放大,旨在帮助用户轻松创造和提升视觉内容,让每个瞬间都变得生动。Viva的主要功能AI视频生成:Viva AI突破了传统视频制作的界限,能够根据文本描述(文生视频)或现有图像(图生视频)生成引人入胜的视频内容,为视频创作者提供了无限的可能性。AI图像生成:利用AI的强大能力,Viva AI能够根据用户的文本描述或现有图像,创造出全新的视觉作品,极大地丰富了图像创作的维度。AI图像增强:平台的AI图像增强功能可以显著提升图像的清晰度、色彩和细节,使得每一张图像都焕发出专业级别的光彩。AI视频增强:Viva AI的视频增强技术能够对视频内容进行深度优化,无论是提高分辨率(最高4K)还是增强动态效果,都能让视频内容更加生动和吸引人。图像重绘:Viva AI的图像重绘功能允许用户对图像进行风格转换或外观调整,满足个性化设计的需求,创造出独一无二的视觉体验。图像扩展:通过智能算法,Viva AI能够无缝扩展图像的画幅或内容,同时保持图像质量,为用户提供更大的创作空间。图像消除:Viva AI的自动背景移除功能,使用户能够轻松去除图像中的背景元素,专注于突出主题,简化了复杂的图像编辑过程。如何使用Viva生成视频访问Viva的官网(vivago.ai/video),国内版为HiDream.ai选择Text to Video文生视频输入提示词,设置负面提示词、视频画面比例和运动强度最后点击Generate等待视频生成即可你也可以选择Image to Video上传图片进行图生视频Viva的应用场景社交媒体内容:创作者可以利用Viva生成有趣的视频内容,用于吸引粉丝和提高社交媒体平台的互动率。广告制作:企业或个人可以使用Viva快速制作广告视频,节省成本同时保持创意和吸引力。电影和视频制作:电影制作人和视频编辑者可以使用Viva作为前期创意和概念验证的工具。艺术创作:艺术家和设计师可以使用Viva将他们的创意想法转化为视觉作品,探索新的艺术表现形式。个人娱乐:用户可以为自己或朋友制作个性化的视频,用于纪念特殊时刻或分享生活趣事。

Hedra

Hedra是什么Hedra是由原斯坦福大学的研究团队成立的数字创作实验室推出的AI对口型视频生成工具,专注于将人工智能技术应用于人物角色视频的生成。用户可以上传任意人物的照片和语音,Hedra会根据这些输入生成动态视频,其中人物的唇形、表情和姿态都能与语音内容完美同步。Hedra支持文本和图片生成视频,目前在免费公测中,提供无限时长的视频生成能力,单个视频最长可达30秒(开放预览版),并且每60秒的输入可以生成90秒的视频。Hedra的主要功能文本和图片生成视频:Hedra的核心功能之一是能够将用户的文本和图片输入转化为动态视频。用户上传一张人物的照片和相应的语音文件,Hedra的AI技术会分析语音的节奏、音调和强度,然后精确地调整视频中人物的唇形和面部表情,以匹配语音的节奏和情感。这使得生成的视频看起来非常自然,就像人物在实时说话或唱歌一样。无限时长视频生成:Hedra在开放预览期间提供了无限时长的视频生成能力,用户可以创建更长、更复杂的视频内容。虽然目前单个视频最长的视频长度限制为30秒,但这已经足够用于制作许多类型的短视频内容,如社交媒体帖子、广告、音乐视频等。高效率视频制作:Hedra的算法优化了视频生成的流程,提高了制作效率。用户输入60秒的语音和文本,Hedra可以生成长达90秒的视频。这种效率的提升对于需要快速制作大量视频内容的用户来说非常有用。表情同步:Hedra的AI技术能够确保视频中人物的表情和唇形与输入的语音内容精确同步,包括基本的发音同步,以及更细微的表情变化,如微笑、皱眉或惊讶,从而传达更丰富的情感和语境。多样化角色支持:Hedra不仅限于生成单一角色的视频,支持多样化的角色创建(人类、动漫、动物、石像等),每个角色都可以具有独特的表情、动作和语音。虚拟世界构建:Hedra计划推出的Worlds功能将是一个创新的步骤,允许用户构建和探索自己的虚拟世界。这些世界可以包含多个角色、环境和交互元素,为用户的故事讲述提供无限的可能。创意控制:Hedra提供了一个高度创意的控制面板,用户可以在这个面板上调整角色的外观、动作、语音和环境设置。用户能够精确地实现他们的创意愿景,无论是制作教育视频、商业广告还是艺术作品。跨平台使用:Hedra的设计考虑了用户的便利性,支持在多种设备上使用,包括桌面电脑和移动设备。这种跨平台的支持使用户可以在任何地方、任何时间进行创作,不受设备限制。如何使用Hedra访问Hedra的官方网站(hedra.com),点击Try Beta然后进行登录/注册登录成功后在Audio分栏导入音频或生成音频,并选择音色然后在Character分栏上传角色图片或者输入提示词生成角色最后在Video分栏处点击Generate Video等待生成视频即可生成后的视频可点击下载或进行分享常见问题Hedra是免费的吗?Hedra目前处于免费公测中,不限总时长生成。Hedra基于什么大模型?Hedra基于该公司自研的Character-1角色生成模型。Hedra可生成时长多少秒的视频?Hedra目前单次最长可生成30秒的角色视频。Hedra支持生成哪些画面比例的视频?Hedra目前支持生成1:1画面比例的视频,即将推出16:9的比例。

StableVicuna:StabilityAI推出的第一个通过RLHF训练的大规模开源聊天机器人

StableVicuna 是由 Stable Diffusion 背后的 StabilityAI 推出的第一个通过基于人类反馈的强化学习(RLHF)训练的大规模开源聊天机器人。StableVicuna是Vicuna v0 13b的进一步指令微调和RLHF训练版本,它是一个指令微调的 LLaMA 130亿模型。

序列猴子:出门问问推出的一款超大规模的语言模型

序列猴子是出门问问推出的一款超大规模的语言模型,具有长序列、多模态、单模型、大数据等特点。利用其通用的表示能力与推理能力,用户能够进行多轮交互,从而在使用中获得更加便捷流畅的体验。

白日梦AI

白日梦AI是一款领先的文生视频类AIGC创作平台,专注于AI视频内容生成,提供AI生成视频教程、AI文生视频、AI动态画面、AI形象生成、人物/场景一致性等创作技巧及成功案例,助您快速上手并打造专业级视频内容。

暂无评论...